Käuferleitfaden für KI-Lernprodukte

Verwendung dieses Leitfadens

Künstliche Intelligenz (KI) wird für L&D-Teams (Learning & Development) immer wichtiger, um Trainingsprogramme zu verbessern, Mitarbeitende zu motivieren, den Erfolg der Organisation voranzutreiben und wettbewerbsfähig zu bleiben. Aber sind alle KI-Lernprodukte gleichwertig? Wahrscheinlich nicht.

Wie unterscheidet man also zwischen Hype und wirklich nützlichen Lösungen?

Hier setzt dieser Leitfaden an. Der „Käuferleitfaden für KI-Lernprodukte“ soll L&D-Professionals dabei unterstützen, sich im KI-Lernumfeld zurechtzufinden, wertvolle Einblicke zu erhalten und fundierte Entscheidungen zu treffen, wenn es um den Kauf von KI-Lösungen für Lerninitiativen geht.

Ob Sie nun das Potenzial von KI zur Personalisierung von Lerninhalten, zur Automatisierung administrativer Aufgaben oder zur Optimierung der Inhaltsbereitstellung erkunden – dieser Leitfaden bietet Ihnen einen Fahrplan, um KI-Tools auszuwählen, die den spezifischen Bedürfnissen Ihrer Organisation entsprechen.

Die sich wandelnde Landschaft

KI wird schnell zu einem integralen Bestandteil von Unternehmen. Laut aktuellen Studien nutzen 35 % der globalen Unternehmen KI.

Doch nicht nur die Verfügbarkeit (oder Neuartigkeit) treibt diese schnelle Verbreitung voran. KI wird zunehmend zur Notwendigkeit, unter anderem aufgrund von zwei makroökonomischen Trends, die die Arbeitswelt stark beeinflussen:

- Die Beziehung zwischen Bevölkerungswachstum und Arbeitslosigkeit

- Stark veränderte Anforderungen und Erwartungen an L&D-Teams

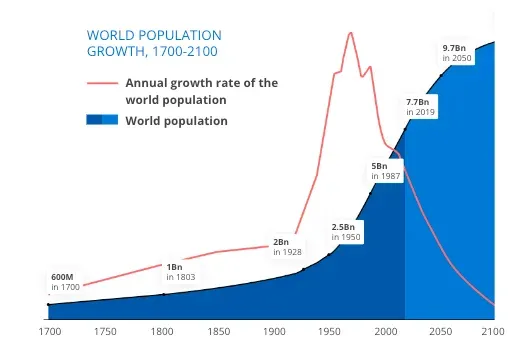

Beginnen wir mit der jährlichen Bevölkerungswachstumsrate – oder, genauer gesagt, dem Fehlen derselben.

Die Geburtenrate ist weltweit dramatisch gesunken. Laut The Economist haben die 15 größten Länder (gemessen am BIP) alle eine Fertilitätsrate unter der Reproduktionsrate. Das bedeutet, dass Menschen schneller aus der Erwerbsbevölkerung ausscheiden, als sie ersetzt werden können.

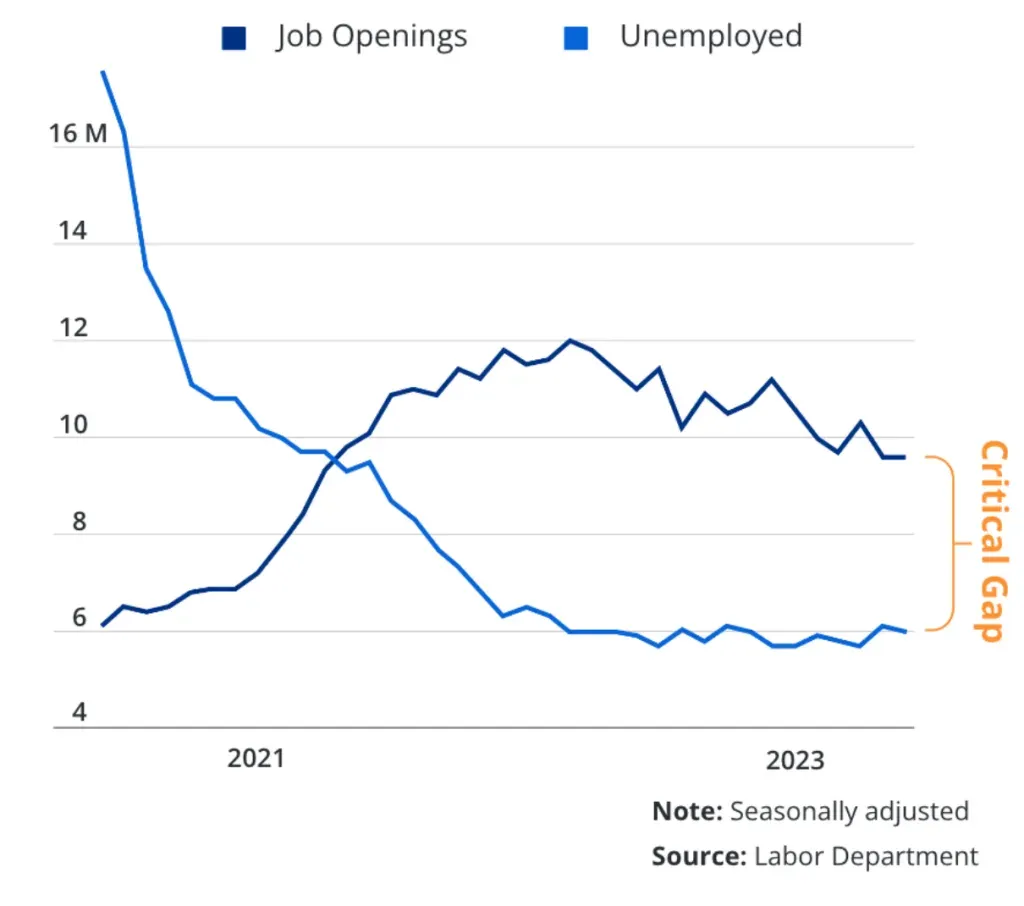

Früher gab es mehr Arbeitslose als offene Stellen. In den letzten Jahren hat sich dieses Verhältnis umgedreht: Es gibt nun mehr offene Stellen als verfügbare Arbeitskräfte. Das führt zu einem Arbeitskräftemangel und erhöht den Wettbewerb um qualifizierte Mitarbeitende.

Die Demografie ist nicht das Einzige, was sich dramatisch entwickelt. Die Lernlandschaft hat sich ebenfalls stark verändert – sie ist heute deutlich größer.

Vor zehn Jahren waren die meisten Trainingsmaßnahmen intern ausgerichtet (Onboarding, Talententwicklung, Compliance etc.), mit wenigen Programmen für eine kleine Anzahl von Lernenden. Heute erweitern immer mehr Organisationen das Lernen auch auf externe Zielgruppen, wie Kunden, Partner oder Franchise-Nehmer.

Dies ist kein Einzelfall in unserem Unternehmen. Es ist bezeichnend für einen größeren Trend. Studien, darunter eine aktuelle Studie der Brandon Hall Group, zeigen, dass mehr als 50 % der Unternehmen externen Gruppen, die keine Mitarbeiter sind, Schulungen anbieten. Dazu gehören Kunden, Kanalpartner, Distributoren, Wiederverkäufer und Franchisenehmer.

Sobald sich die Schulung auf externe Gruppen ausdehnt, wächst die Zahl der Lernenden (und damit auch die Zahl der Programme und Inhalte, die zu ihrer Unterstützung benötigt werden) exponentiell.

Das Versprechen der Künstlichen Intelligenz (KI)

Weniger Menschen. Mehr Arbeit. Das ist unsere Realität – und ein großer Grund, warum KI so attraktiv ist.

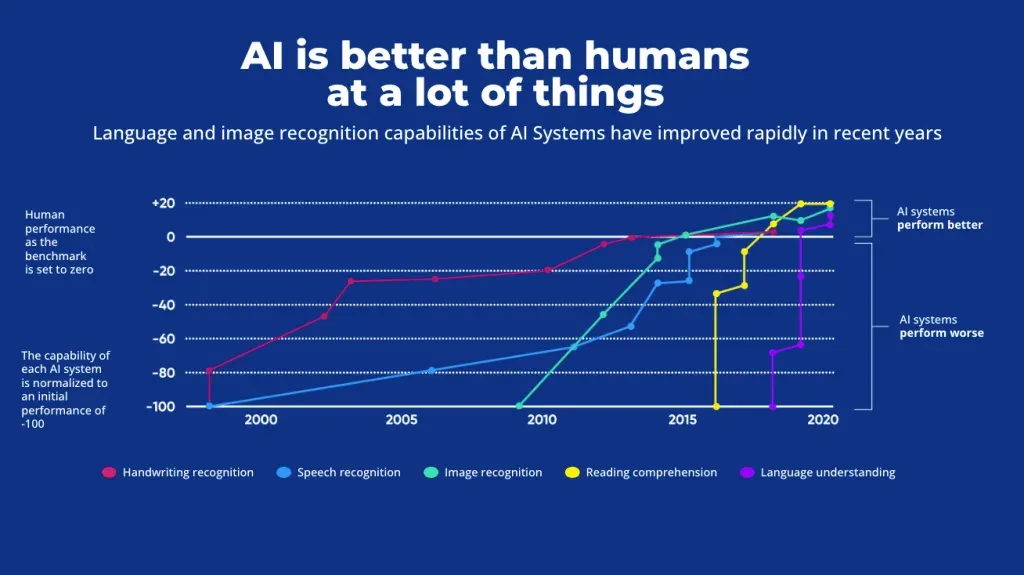

KI übertrifft den Menschen in vielen Bereichen, etwa bei Bilderkennung, Textverständnis und Sprachverarbeitung. Das ermöglicht Unternehmen, den Fachkräftemangel abzumildern und gleichzeitig Effizienzsteigerungen durch die Auslagerung repetitiver Aufgaben zu erzielen.

Forrester prognostiziert, dass KI-Initiativen in Unternehmen die Produktivität und kreative Problemlösung um 50 % steigern werden. Die Integration von KI in das Unternehmen kann nicht nur dazu beitragen, den Arbeitskräftemangel zu lindern, sondern auch Wettbewerbsvorteile bringen. Laut Daten von 2023 spart ein Mitarbeiter durch KI im Durchschnitt 2,5 Stunden pro Tag.

Obwohl KI-Lösungen ein großes Potenzial und vielversprechende Möglichkeiten bieten, ist es wichtig zu bedenken, dass ein KI-Produkt für einen Teil des Unternehmens möglicherweise nicht für einen anderen hilfreich ist. Eine KI-gestützte Lösung für die Vertragsprüfung kann beispielsweise die Produktivität und Effizienz Ihrer Rechtsabteilung steigern, aber sie wird dem Lern- und Entwicklungsteam nicht viel nützen. Mit anderen Worten: Nicht jede KI-Lösung ist geeignet. Sie benötigen zweckgerichtete KI-Produkte für Ihr gesamtes Unternehmen, und die L&D-Teams benötigen Lösungen für das Lernen mit KI.

Wussten Sie schon

Im Jahr 2008 haben Entwickler eine schachspielende KI namens Stockfish entwickelt und ihr die Regeln und Strategien des Spiels beigebracht. Bei voller Leistung ist es für einen Menschen fast unmöglich, gegen Stockfish zu gewinnen. Im Dezember 2017 wurde eine konkurrierende KI namens AlphaZero entwickelt. Dieser KI wurde die Strategie nie beigebracht, sondern sie trainierte sich einfach selbst, indem sie eine große Anzahl von Schachpartien beobachtete und einige Tage lang Übungspartien gegen sich selbst spielte. Mit der gleichen Rechenleistung, die hinter jedem Modell steht, schlägt AlphaZero Stockfish regelmäßig.

Was ist KI für das Lernen?

Wenn wir über „KI für das Lernen“ oder „Lern-KI“ sprechen, meinen wir KI-Produkte, -Modelle und -Agenten, die speziell dafür entwickelt wurden, Instructional Designer, L&D-Teams und andere Bildungsexperten zu unterstützen.

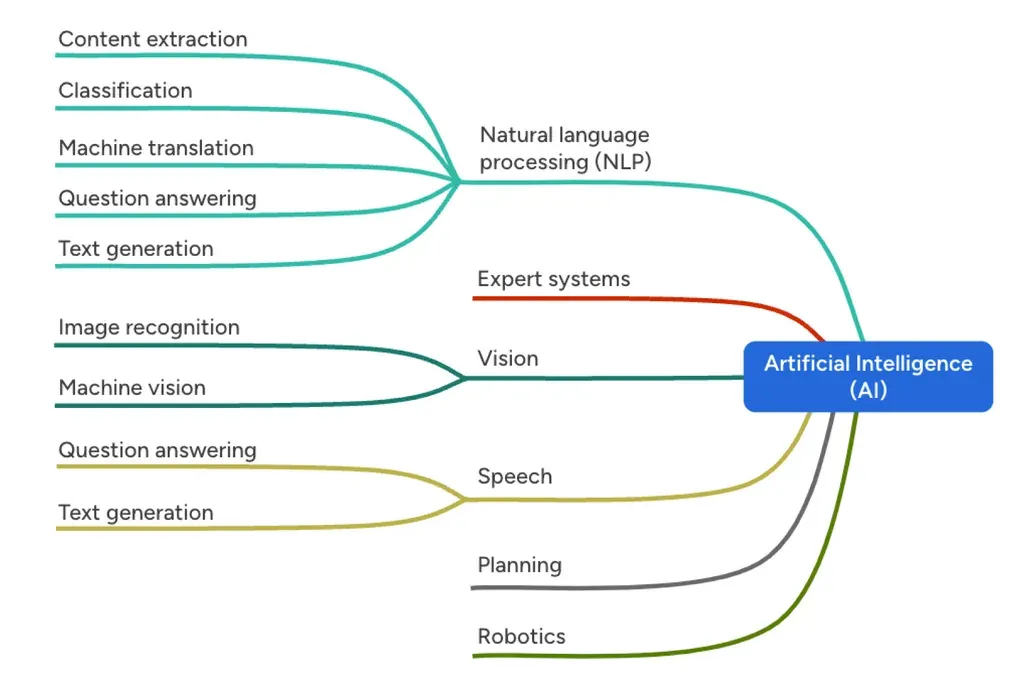

Im größeren Kontext der KI gehören heutige Lern-KI-Produkte im Allgemeinen zu den Bereichen Natural Language Processing (NLP), Sprachverarbeitung und Computer Vision – und alle greifen dabei auf maschinelles Lernen zurück.

Wenn Sie Lern-KI-Lösungen bewerten, ist es hilfreicher – und wahrscheinlich auch praktischer –, Lern-KI danach zu beurteilen, was sie tut, also welche Aufgaben sie ausführen kann.

Noch wichtiger: Welche Aufgaben kann sie übernehmen, die für Ihre L&D-Organisation relevant sind? Genau dort liegt die eigentliche Chance.

Vielleicht haben Sie Schwierigkeiten, Instructional Designer einzustellen, sodass Ihr Team bei der Inhaltserstellung zurückfällt. Vielleicht sind die Anforderungen an Ihr Team höher als Ihre Produktionskapazität. Möglicherweise gibt es Kompetenzlücken, die verhindern, dass Ihr Team Daten analysieren kann. Oder Sie skalieren Ihre Programme oder Ihr Unternehmen und benötigen Übersetzungsfunktionen.

Letztlich sollte eine Lern-KI Ihnen helfen, ein bestimmtes Problem zu lösen.

Ihre Entscheidung sollte daher problemorientiert und nicht produktorientiert sein.

Hier ein Tipp

Ein guter Ansatz ist es, eine potenzielle KI-Anschaffung so zu behandeln wie die Einstellung eines neuen Mitarbeiters. (Sie kaufen kein Produkt – Sie holen sich Unterstützung ins Team!)Sie würden niemanden einstellen, nur weil er gut gekleidet und verfügbar ist. Ebenso sollten Sie kein KI-Produkt kaufen, nur weil es smart und glänzend wirkt.

Wie Menschen haben auch KI-Tools Grenzen. Bei Bewerbern entdecken Sie diese Grenzen im Vorstellungsgespräch. Die Produktevaluierung ist Ihre Chance, mögliche Einschränkungen der KI aufzudecken und sicherzustellen, dass Ihre Prozesse Kontrollmechanismen enthalten, die die mit diesen Einschränkungen verbundenen Risiken verringern.

Grundlegende Konzepte der lernenden KI

Um eine fundierte Entscheidung beim Kauf von KI-Produkten treffen zu können, sollten Sie mit einigen grundlegenden Konzepten vertraut sein.

01 KI-Modelle

Ein KI-Modell ist die zentrale Komponente eines KI-Systems, die für die eigentliche Verarbeitung und Entscheidungsfindung verantwortlich ist. Es wird dafür entwickelt, eine bestimmte Aufgabe auszuführen (z. B. Bilderkennung, Sprachverstehen, Empfehlungen usw.).

KI-Modelle sind sozusagen die Motoren hinter einer Lösung. Sie nehmen Eingabedaten auf, verarbeiten sie und erzeugen ein Ergebnis – etwa eine Vorhersage oder eine Klassifizierung.

KI-Modelle werden auf riesigen Datensätzen trainiert, um Muster und Informationen zu erkennen, die für ihre Aufgabe relevant sind. Das Training ist sehr ressourcenintensiv und findet in der Regel vor dem Einsatz des Modells statt. Selbst die heute populärsten KI-Modelle haben Lücken in ihren Trainingsdaten.

Da KI-Modelle sehr komplex sein können – mit zahlreichen Parametern, Schichten und Algorithmen (insbesondere bei Deep-Learning-Modellen wie neuronalen Netzen) – kann ihr Einsatz in großem Maßstab erhebliche Ressourcen erfordern. Dafür ist oft leistungsstarke Hardware notwendig, was die Kosten für die Generierung von Inhalten bei jeder Anfrage erhöht.

Glücklicherweise sind KI-Modelle nur ein Teil der sich ständig weiterentwickelnden Landschaft. Die meisten KI-Lernprodukte nutzen zusätzliche Strategien und Technologien, beispielsweise KI-Agenten, um allgemeine KI-Modelle zu erweitern und spezialisiertere, leistungsfähigere und flexiblere Lösungen bereitzustellen.

02 KI-Agenten

Ein KI-Agent ist ein spezialisierter, KI-gestützter Prozess oder ein Programm, das weitgehend autonom arbeitet, jedoch durch Benutzereingaben beeinflusst wird. KI-Agenten nutzen große Sprachmodelle – wie die von OpenAI GPT (und anderen) – um die Absicht des Nutzers zu verstehen und anschließend Aufgaben und Ziele selbstständig auszuführen.

Agenten können sich an neue Informationen oder veränderte Situationen anpassen.

Im Gegensatz zu traditionellen KI-Modellen, die in der Regel statisch sind und nur die Aufgaben ausführen, für die sie explizit programmiert wurden, sind KI-Agenten dynamisch und flexibel. Außerdem können sie mit Werkzeugen ausgestattet werden (z. B. Zugriff auf Datenquellen oder Interaktion mit anderen KI-Modellen), deren Einsatz sie eigenständig und situationsabhängig entscheiden.

KI-Agenten verfügen über ein Maß an Autonomie, das es ihnen ermöglicht, in unvorhersehbaren oder wechselnden Umgebungen zu arbeiten. Sie können Entscheidungen treffen, ihr Vorgehen anpassen und sogar aus den Ergebnissen dieser Entscheidungen lernen. Diese Anpassungsfähigkeit ist besonders wichtig in Bereichen wie der Robotik (etwa bei selbstfahrenden Autos), wo Agenten reale Umgebungen navigieren müssen, oder in virtuellen Lernumgebungen für Aufgaben wie Lernendeninteraktionen, bei denen sie mit Menschen in fließenden, oft unvorhersehbaren Gesprächen interagieren.

Ein zentrales Merkmal, das KI-Agenten von reinen Modellen unterscheidet, ist ihre Fähigkeit zu zielgerichtetem Verhalten. Sie verarbeiten nicht nur Eingaben und reagieren darauf – sie arbeiten aktiv auf bestimmte Ziele hin. Gerade bei adaptivem, personalisiertem Lernen werden KI-Agenten wahrscheinlich eine große Rolle spielen, indem sie direkt mit Lernenden interagieren und auf Lernlücken reagieren, die im Verlauf dieser Interaktionen sichtbar werden.

Im Lernbereich kann ein KI-Agent so entwickelt werden, dass er sich auf Förderbedarf konzentriert, also Teammitglieder unterstützt, die vom Kurs abweichen oder zusätzliche Hilfe benötigen.

Er kann beispielweise:

- virtuelle Chat- oder Video-Rollenspiele ermöglichen, die einen sicheren Raum für wiederholtes Üben schaffen – mit einem Partner, der nie ermüdet und sich dem Fortschritt der Lernenden anpasst.

- bei der Optimierung unterstützen, indem er große Datenmengen analysiert und Möglichkeiten zur Prozessverbesserung erkennt, um ein Ziel oder KPI effizienter zu erreichen.

- bei Mastery-Learning oder Zertifizierungen eingesetzt werden, indem er Lernende durch verschiedene Lernstufen zu echter Kompetenz führt – basierend auf didaktisch fundierten Frameworks wie Blooms Taxonomie oder Backward Design.

Wie bei allen KI-Interaktionen gilt: Agenten, ihre Arbeit und ihre Ergebnisse sollten von Menschen überwacht und eingeordnet werden, insbesondere bei Aufgaben und Szenarien mit hohem Risiko.

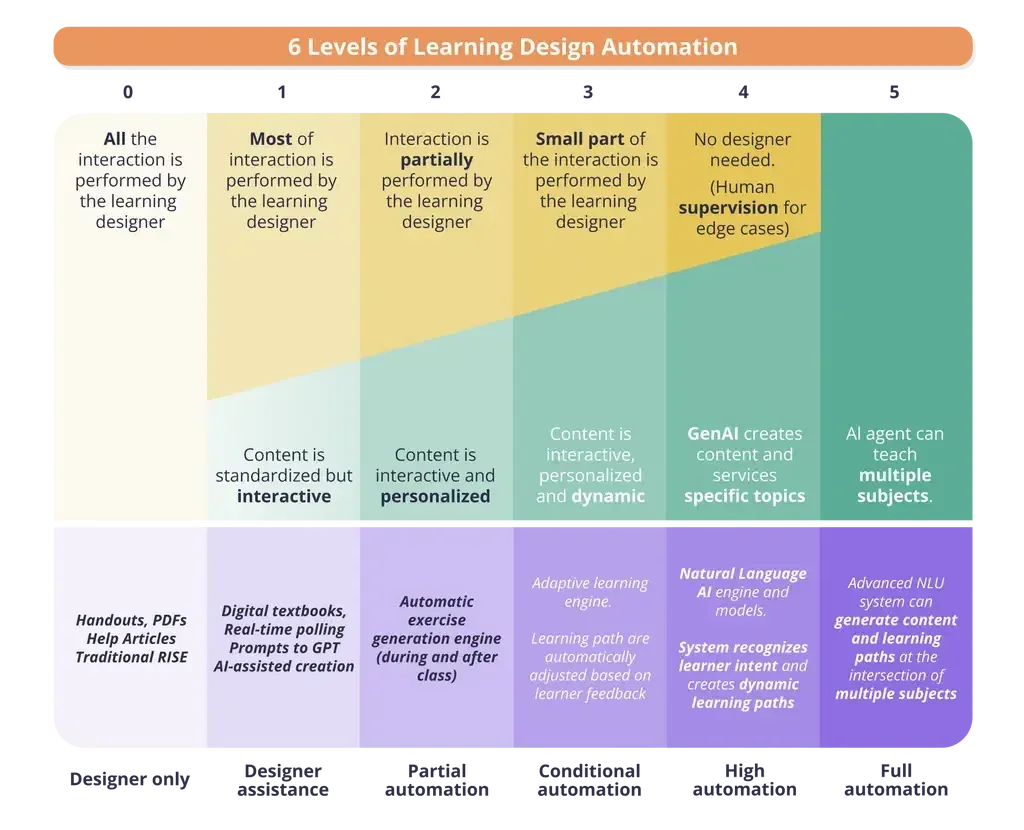

Stufen der Automatisierung des Lerndesigns

Wenn Sie KI in Ihrer Organisation einführen, ist es wichtig, die Schnittstelle zwischen KI und menschlichem Lern-Design zu betrachten. Mit zunehmender Automatisierung verschiebt sich das Verhältnis zwischen Mensch und Maschine – insbesondere in Bezug auf Kontrolle, Personalisierung und Ergebnisqualität.

Auf der linken Seite haben Sie eine starke menschliche Kontrolle über das System, das Sie nutzen. Aktionen und Entscheidungen werden hauptsächlich von den Inhalten oder dem Instructional Designer gesteuert – und die Verbesserungen oder Automatisierungen durch KI sind, wenn überhaupt, sehr begrenzt.

Bewegen Sie sich jedoch weiter nach rechts auf der Skala, wird ein größerer Teil der Entscheidungen und Aktionen an das KI-System übergeben. Im Gegenzug erhalten Sie deutlich mehr Personalisierung, Automatisierung, Zeitersparnis und Skalierbarkeit für Ihr Lernprogramm.

Die Vorteile einer tieferen Automatisierung gehen weit über die oben genannten Punkte hinaus. In fast allen Geschäftsbereichen gibt es eine gewisse Menge an wiederholenden, manuellen Aufgaben, die die Produktivität eher behindern als fördern. Das kann das Zusammenfassen oder Neuorganisieren von Daten sein. Es kann das Schreiben von Quizfragen sein. Oder dieser eine Fall, in dem Sie Stunden damit verbringen mussten, Metadaten neu zu beschriften, weil eine einzige Tabelle durcheinandergeraten war.

Mühsame, wiederkehrende Kleinarbeit ist ein unsichtbarer, schleichender Bestandteil des Arbeitslebens, den künstliche Intelligenz mühelos bewältigen kann. Wenn Sie 20 % Ihres Tages mit solchen zeitraubenden Tätigkeiten verbringen, kann KI Ihnen diese Zeit zurückgeben und Ihnen helfen, vorauszuarbeiten – oder manchmal einfach nur wieder aufzuholen.

All das passiert jedoch nicht auf Level 1 der oben beschriebenen Tabelle. Um Zeit zurückzugewinnen und Aufgaben an KI zu delegieren, müssen Sie zunächst das Problem verstehen, das Sie lösen möchten, und dann eine Lösung finden (z. B. maschinell lernbasierte Inhaltskuratierung, Datenanalyse, KI-gestütztes Skills-Mapping oder generative KI-Tools zur Inhaltserstellung), die genau auf dieses Problem ausgerichtet ist.

Apropos generative KI – jetzt ist ein guter Zeitpunkt, um zu erläutern, was sie ist und wie sie auf hoher Ebene funktioniert.

Generative KI (GenAI) erklärt

Vor der Ära der generativen KI spezialisierte sich künstliche Intelligenz in der Regel darauf, Dinge zu erkennen und vorherzusagen. Sie konnte zum Beispiel die Kringel eines eingescannten Dokuments in bearbeitbaren Text umwandeln oder eine Audiodatei transkribieren, indem sie Wörter aus den Schallwellen erkannte. Auf Smartphone-Tastaturen konnten einfache Formen künstlicher Intelligenz Ihr nächstes Wort vorhersagen oder erraten.

Mit generativer KI jedoch erschafft künstliche Intelligenz Dinge – basierend auf Mustern, die sie in den Quelldaten erkennt.

Wussten Sie schon

Generative KI kann ein Sonett im Stil von William Shakespeare schreiben. Shakespeare war unglaublich konsistent, und es hilft, dass er seinen Namen unter die meisten seiner Sonette gesetzt hat.

GenAI kann auch Kunst im Stil von Vincent van Gogh erzeugen. Das eröffnet eine Vielzahl spannender Möglichkeiten, bringt aber auch ethische Fragen mit sich—insbesondere in Bezug auf das Urheberrecht der Künstler, deren Werke in diesen Modellen landen, ohne dass sie ausdrücklich zugestimmt haben.

Im Kern nutzt generative KI Deep-Learning-Modelle, die gigantische Datenbibliotheken analysieren. Das können alle Bilder und Texte sein, die in der Public Domain liegen, öffentlich zugängliche Social-Media-Beiträge, Nachrichtenartikel und vieles mehr.

Je mehr Daten KI-Unternehmen ihren Modellen zuführen, desto genauer und zuverlässiger werden diese Modelle.

Während die KI Daten verarbeitet, beginnt sie, Muster zu erkennen—Muster, die für Menschen völlig selbstverständlich sind, über die wir aber nie bewusst nachdenken.

Das können beispielsweise sein:

- wie Licht in einem Foto vom Auge einer Person reflektiert,

- die vorhersehbare Struktur, in die Substantive und Verben in den meisten Sätzen fallen,

- oder sogar die richtige Aussprache von „emphasis“.

Das alles sind Muster, über die wir nicht aktiv nachdenken—aber die uns sofort auffallen, wenn sie „nicht richtig“ sind. Und nach der Analyse von Millionen, wenn nicht Milliarden von Dokumenten, Bildern und Videos erkennt KI diese Muster ebenfalls, besonders dann, wenn das Trainingsmaterial selbst konsistent ist.

Generative KI interpretiert diese Muster als das, was Menschen tun und erwarten. In vielerlei Hinsicht versucht sie einfach, uns genau das zu geben, was wir wollen.

Wenn wir bewusst auswählen, welche Daten wir zum Trainieren nutzen und wie wir sie verarbeiten lassen, erhalten wir im Ergebnis oft etwas, das unglaublich nah an unserem eigenen Output liegt—oder fast genauso gut.

Hier ist ein Tipp

Falls unklar ist, ob ein Bild real oder KI-generiert ist:

- Text und Logos genauer betrachten.

KI-generierter Text wirkt häufig pixelig, verzogen oder unregelmäßig.

Logos erscheinen oft verfremdet oder unscharf.

- Hände prüfen, wenn Personen abgebildet sind.

In vielen nicht auf Bildgenerierung spezialisierten Modellen ist das Trainingsmaterial für Hände begrenzt—sie wirken oft verzerrt oder unnatürlich.

Potenzielle Herausforderungen bei KI-Lösungen

KI kann sich manchmal wie Magie anfühlen. Man erhält Ergebnisse, ohne zu wissen oder zu verstehen, wie die KI zu diesen Ergebnissen gelangt ist. Das ist problematisch. Dies ist nicht Oz. Wir müssen darauf achten, was hinter dem Vorhang geschieht – oder im Fall von KI: was sich im Black Box-System abspielt.

01 Das Black-Box-Problem

Wie der französische Philosoph Bruno Latour betonte: „Je erfolgreicher Wissenschaft und Technologie werden, desto undurchsichtiger und unverständlicher werden sie.“

Dies gilt insbesondere für Machine Learning, bei dem oft selbst die Entwicklerinnen und Entwickler der KI nicht erklären können, warum oder wie das System zu einer bestimmten Entscheidung gelangt ist.

Diese fehlende Einsicht wird als Black-Box-Problem bezeichnet. Es beschreibt die Herausforderung, die Entscheidungsprozesse komplexer Machine-Learning-Modelle zu verstehen oder nachzuvollziehen, da sie mit internen Mechanismen arbeiten, die schwer zu erklären oder vorherzusagen sind.

Zentrale Aspekte dieses Problems sind:kte:

Mangelnde Transparenz: Tiefe neuronale Netze, wie sie Generative KI antreiben, bestehen aus zahlreichen Schichten und Parametern – oft in Milliardenhöhe. Es ist kaum nachvollziehbar, wie jeder einzelne Parameter das Endergebnis beeinflusst. (Selbst wenn das System seinen Entscheidungsweg erläutern würde, hätten Sie vermutlich nicht genug Lebenszeit, um alles zu verstehen.)

Diese Intransparenz erschwert es, nachzuvollziehen, wie genau ein Modell zu einer Entscheidung gelangt ist.

Komplexität: Machine-Learning-Modelle können hochgradig komplexe Muster und Zusammenhänge erkennen, die für Menschen kaum fassbar sind. Sie arbeiten möglicherweise mit Merkmalen oder Beziehungen, die für uns nicht offensichtlich sind – etwa implizite Verzerrungen oder Lücken in den gesammelten Daten.

Schwierigkeiten bei der Fehlersuche: Wenn ein KI-Modell einen Fehler macht oder eine verzerrte Entscheidung trifft, ist die Ursachenanalyse oft schwierig. Das erschwert Debugging, Optimierung und Qualitätssicherung.

Ethische Bedenken: In Bereichen, in denen KI kritische Entscheidungen trifft (z. B. Finanzwesen, Gesundheit, Recht), verschärft das Black-Box-Problem ethische Risiken. Stakeholder sollten Entscheidungen nicht blind vertrauen, wenn Modelle weder interpretierbar noch erklärbar sind.

Die Auseinandersetzung mit dem Black-Box-Problem ist ein aktives Forschungsfeld. Forschende entwickeln Methoden für mehr Interpretierbarkeit und Transparenz – etwa Visualisierungen des Modellverhaltens, Erklärungen für Merkmalsbedeutung oder Ansätze zur Begründung von Entscheidungen. Dies ist entscheidend, um Fairness, Verantwortlichkeit und Transparenz in realen Anwendungen sicherzustellen. (Mehr dazu im Kapitel Frameworks für erfolgreiche KI.)

02 Halluzinationen

KI hat enorme Fortschritte gemacht – aber sie ist weit davon entfernt, perfekt zu sein.

KI-Modelle können Informationen oder Inhalte erzeugen, die nicht auf realen Daten oder echtem Wissen basieren. Diese sogenannten Halluzinationen reichen von kleinen Ungenauigkeiten bis hin zu klaren Fehlbehauptungen oder frei erfundenen Sachverhalten. Da die Ergebnisse in der Regel kohärent und grammatikalisch korrekt sind, wirken sie überzeugend und können leicht für wahr gehalten werden.

Halluzinationen entstehen aus verschiedenen Gründen:

- Fehler oder Verzerrungen in Trainingsdaten

- Modellkomplexität

- unzureichende Kontrolle oder Überwachung während des Trainings

- ungeeignete oder missverständliche Prompts

In der Sprachverarbeitung etwa erzeugen Modelle manchmal Texte, die zwar flüssig wirken, aber vollständig erfunden sind – zum Beispiel Beschreibungen fiktiver Ereignisse, die wie reale Berichte klingen.

03 Bias in der KI

Bias in KI bezeichnet das Vorhandensein unfairer oder ungerechter Verzerrungen in den Entscheidungen oder Vorhersagen künstlicher Intelligenz. Sie können aus vielen Quellen stammen und zu diskriminierenden oder ungleichen Ergebnissen führen.

Auch wenn die Risiken im Lernen geringer erscheinen als in der Gesundheitsversorgung oder im Strafrecht, können Verzerrungen Lernprogramme dennoch erheblich beeinträchtigen. Bias kann unter anderem entstehen durch:

Verzerrte Trainingsdaten

Wenn Trainingsdaten Vorurteile oder gesellschaftliche Ungleichheiten widerspiegeln (z. B. historische, demografische oder statistische Verzerrungen), übernimmt das Modell diese – und verstärkt sie möglicherweise. Ein bewusst gestaltetes System, das beispielsweise geschlechtergerechte Beispiele erzeugt, könnte solchen Verzerrungen entgegenwirken.

Algorithmische Verzerrung

Einige Algorithmen bevorzugen strukturell bestimmte Gruppen oder liefern für diese schlechtere Ergebnisse – etwa Gesichtserkennung, die bei dunkleren Hauttönen weniger akkurat ist, oder Spracherkennung, die mit regionalen Dialekten Probleme hat.

Labeling Bias

Personen, die Daten labeln, bringen häufig unbeabsichtigte eigene Vorurteile ein. Da KI auf Mustern menschlicher Entscheidungen basiert, übernimmt sie diese Verzerrungen. Das Ergebnis: Das System zeigt genau so viel Bias wie der Mensch, von dem es gelernt hat.

Feedback-Schleifen

KI lernt nicht nur aus Trainingsdaten, sondern auch aus der Interaktion mit Menschen. Wenn Nutzerinnen und Nutzer verzerrte Inhalte bevorzugen oder positiv bewerten, verstärkt das Modell diese Verzerrungen. So entstehen selbstverstärkende Bias-Effekte.

Im Kontext von Learning-KI ist Bias ein besonders großes Risiko. Keine zwei Lernenden sind gleich. Erfolgreiche KI-Implementierung muss Individualisierung ermöglichen und zugleich aggregierte Daten sinnvoll nutzen. Eine solche Kombination erlaubt es der KI, sich an individuelle Bedürfnisse anzupassen – ohne Benachteiligungen zu erzeugen.

Bias zu reduzieren ist entscheidend, um sicherzustellen, dass KI-Systeme gerecht, ethisch und unparteiisch sind und persönliche Lernwege unterstützen, statt sie zu verzerren.

Wussten Sie schon

Laut einer aktuellen Studie haben 86 % der befragten Nutzerinnen und Nutzer bereits Halluzinationen erlebt, wenn sie Chatbots wie ChatGPT oder Bard verwenden.

Trotzdem vertrauen 72 % der Teilnehmenden der KI weiterhin.

Rahmenbedingungen für erfolgreiche KI

Für Probleme wie das Black-Box-Phänomen, Halluzinationen, Bias und weitere grundlegende Herausforderungen in KI gibt es keine schnelle Lösung. Glücklicherweise arbeiten zahlreiche Expertinnen, Experten und Organisationen an eben diesen Themen. Im Zuge der Entwicklung KI-gestützter Lösungen hat das Docebo-Team umfangreiche Recherchen durchgeführt und dabei Prinzipien, Techniken und Frameworks identifiziert, die sich für effektive, lernendenzentrierte und verlässliche KI-Lösungen als besonders hilfreich erwiesen haben.

01 Prüfbarkeit, Erklärbarkeit, Übersteuerbarkeit

Im Bericht des U.S. Department of Education, Office of Educational Technology, KI and the Future of Teaching and Learning (KI und die Zukunft des Lehrens und Lernens) definieren die Autorinnen und Autoren Kriterien für „gute KI-Modelle“ und beschreiben drei Eigenschaften, die wirksame KI im Bildungsbereich aufweisen muss: prüfbar, erklärbar und übersteuerbar.

Prüfbarkeit (Inspectability):

Bezieht sich auf die Möglichkeit für Nutzerinnen und Nutzer, die internen Abläufe der Entscheidungsfindung und Outputgenerierung der KI nachzuvollziehen.

Erklärbarkeit (Explainability):

Bezieht sich auf die Fähigkeit eines Systems, menschenlesbare Erklärungen für seine Entscheidungen abzuleiten und bereitzustellen.

Übersteuerbarkeit (Overridability):

Bezieht sich auf die Möglichkeit, Ausgaben oder Entscheidungen der KI zu ersetzen, zu entfernen oder manuell anzupassen, um eine höhere Kontrolle über das Endergebnis zu behalten.

Gemeinsam schaffen diese Prinzipien jene Transparenz und Steuerbarkeit, die Menschen benötigen, um Entscheidungen der KI zu überprüfen und bei Bedarf anzupassen. Wenn von Nutzerinnen und Nutzern erwartet wird, Kontrolle an ein automatisiertes System abzugeben, ermöglichen diese Prinzipien dennoch eine grundlegende Kontrolle über das Gesamtergebnis. So lassen sich die Vorteile von KI nutzen, ohne blindes Vertrauen in das System haben zu müssen.

02 Retrieval Augmented Generation (RAG)

Eine weitere Möglichkeit, die Zuverlässigkeit der Ergebnisse eines KI-Modells zu erhöhen, ist der Ansatz der Retrieval Augmented Generation (RAG).

RAG ist ein Framework, das auf einer vertrauenswürdigen Wissensbasis aufbaut und damit große Sprachmodelle (Large Language Models, LLMs) anreichert. Es ruft verlässliche Fakten ab, integriert sie in den Generierungsprozess und stellt sicher, dass der Kontext auf aktuellen und geprüften Informationen basiert.

Wichtig ist dabei: Die Parameter und ursprünglichen Trainingsdaten eines Modells sind statisch. Um sie zu aktualisieren, müsste das Modell neu trainiert werden.

RAG ermöglicht es Sprachmodellen jedoch, ohne erneutes Training auf aktuelle, verlässliche Informationen zuzugreifen. Das steigert die Vertrauenswürdigkeit und verringert das Risiko falscher oder irreführender Inhalte deutlich – besonders wertvoll in Anwendungsfällen, in denen faktische Korrektheit entscheidend ist.

Für KI-gestützte Lernlösungen bedeutet das: Die effektivsten und personalisiertesten Systeme greifen auf interne und externe Wissensquellen Ihres Unternehmens zu, um Lerninhalte nicht nur umfassend, sondern auch unternehmensspezifisch zu gestalten.

Damit dies funktioniert, muss jedoch die Qualität der Wissensbasis stimmen – denn wie man so treffend sagt: Garbage in, garbage out.

Ein neuer Fokus auf Wissensmanagement

Die meisten L&D-Fachleute wissen, wie essenziell Wissensmanagement ist. Dennoch kann es herausfordernd sein, funktionsübergreifende Abstimmung für ein solch unternehmensweites Projekt sicherzustellen.

Die Leistung eines KI-Modells hängt direkt von der Qualität der Daten ab. Wenn RAG und Ihre KI-Lösungen auf interne oder externe Wissensquellen zugreifen, wird Wissensmanagement für die gesamte Organisation geschäftskritisch.

Die Wissensbasis fungiert als Rückgrat für Faktenprüfung und Validierung und ermöglicht es dem Modell, korrekte und verlässliche Informationen auszuspielen. Wenn diese Grundlage veraltet, unvollständig oder fehlerhaft ist, entstehen falsche oder überholte Inhalte.

Wenn Ihr Unternehmen also in KI-Produkte investiert, die auf die interne Wissensbasis zugreifen, ist Wissensmanagement entscheidend, um Qualität und Relevanz sicherzustellen.

Erwägen Sie den Aufbau oder die Reaktivierung eines funktionsübergreifenden Teams, das sich dem Wissensmanagement widmet. Wichtige Beteiligte könnten u. a. sein:

- Produkt

- Produktmarketing

- Rechtsabteilung

- Enablement

- Wissensmanagement- bzw. Helpdesk-Teams

- sowie alle weiteren für Ihr Unternehmen relevanten Bereiche, die entscheidende Wahrheiten definieren

03 Risikominderung durch Pädagogik

Nehmen wir an, Sie setzen eine KI zum Lernen ein, deren Modell auf dem Großteil des Internets und Nehmen wir an, Sie implementieren eine KI für Lernzwecke, deren Modell auf große Teile des Internets sowie auf frei verfügbare (und eventuell einige kostenpflichtige) Kurse trainiert wurde. Dann müssen Sie sich einige unbequeme Fragen stellen:

- Sind diese Kurse überhaupt gut oder pädagogisch fundiert?

- Repräsentieren die Trainingsdaten und Muster, auf die sich die KI stützt, den Anspruch, den ich an meine Lernprogramme stelle?

- Kann man jemals beurteilen, ob ein Kurs wirksam war, ohne zu messen, wie Lernende abgeschnitten haben oder was sie behalten konnten?

Im Bereich Learning ist die größte Stärke von Generativer KI zugleich eine ihrer größten Schwachstellen: Modelle orientieren sich strikt an den Mustern der Trainingsdaten. Sie können keine kontextreichen Entscheidungen treffen, die den Mustern widersprechen.

Eine Sammlung von Lerntheorien macht niemanden zur Lernexpertin oder zum erfahrenen Trainer.

Ohne tatsächliches Verständnis der Lernenden und ihrer Ergebnisse basiert die Erstellung von Lerninhalten durch Generative KI hauptsächlich auf theoretischen Annahmen darüber, was funktionieren sollte. Viele L&D-Profis wissen jedoch, wie schnell ein Lernprogramm scheitern kann, wenn die Lernenden nicht im Mittelpunkt stehen.

Wenn Pädagogik auf KI trifft

Ein eingebettetes pädagogisches Modell oder Framework ist der zentrale Erfolgsfaktor für wirksame Learning-KI. Es überbrückt die Lücke zwischen technologischer Leistungsfähigkeit und didaktischer Wirksamkeit, indem es KI-Modelle mit bewährten Lehr- und Lernprinzipien verbindet.

Es liefert die Grundlagen, um wirksame, ansprechende und zielgerichtete Lernerfahrungen zu schaffen – und je wirkungsvoller das Lernen, desto größer der Beitrag zum Unternehmenserfolg. Denn Lernen fördert nicht nur persönliche Entwicklung, sondern ist zugleich ein zentraler Wachstumstreiber für Organisationen.

Die Integration pädagogischer Strategien verbessert die Qualität des Lernerlebnisses, indem Inhalte gezielt, kontextbezogen, messbar und personalisiert generiert werden – und stellt sicher, dass Lernziele effizient und wirkungsvoll erreicht werden.

04 Human-in-the-Loop-Systeme (HILT)

Es gibt zahlreiche Aufgaben mit geringem Risiko, die wir getrost vollständig an KI übergeben können – so wie wir es schon immer mit Technologie getan haben. (Niemand bedient heute mehr manuell die Telefonvermittlungsanlage der ganzen Stadt.)

Gleichzeitig existieren aber weiterhin Bereiche, in denen Menschen immer involviert bleiben müssen. Ein Blick in die Landwirtschaft zeigt dies deutlich: KI unterstützt bereits bei Unkrauterkennung, Wachstumsanalysen und Gesundheitsmonitoring. Dennoch braucht es Landwirtinnen und Landwirte, um kritische Entscheidungen zu treffen.

Lernen ist ähnlich bedeutend – und unabhängig davon, wie sehr KI Fortschritte macht, wird es immer ein Human-in-the-loop-System benötigen.

KI-Systeme treffen Vorhersagen und Entscheidungen, doch selten mit absoluter Sicherheit. Das Konzept absoluter Gewissheit ist zutiefst menschlich.

Deshalb sind HILT-Systeme unerlässlich: Sie ermöglichen es Menschen, Nuancen und Kontextfaktoren zu berücksichtigen, die KI nicht vollständig erfassen kann – und damit ein Gleichgewicht zwischen KI-gestützten Erkenntnissen und menschlicher Urteilskraft herzustellen.

Die wirkungsvollsten KI-Lösungen eliminieren nicht die menschliche Beteiligung. Sie ermöglichen sie auf jeder Stufe: zur Validierung der Ergebnisse, zur Einordnung im Gesamtzusammenhang, zur Bereitstellung von Feedback und zur Anwendung ethischer und moralischer Überlegungen.

Wussten Sie schon

Andragogik oder Pädagogik?

Andragogik bezeichnet bewährte Methoden für das Lehren Erwachsener, während Pädagogik üblicherweise auf Methoden für Kinder angewendet wird.

In der Praxis wird „Pädagogik“ jedoch häufig breiter genutzt – auch an Hochschulen – und bezieht sich dann auf Lehr- und Lernmethoden für Erwachsene und Kinder gleichermaßen.

Wenn wir den Begriff „Pädagogik“ verwenden, ist diese breitere Bedeutung gemeint und berücksichtigt, dass unsere Lernenden Erwachsene sind.

Von menschlichen Prozessen zu KI-Frameworks

Ganz gleich, ob Sie im Bereich Grafik, Authoring oder Instructional Design tätig sind – Ihrer Arbeit liegt stets ein kreativer Prozess zugrunde. Diese Prozesse sind wiederholbar, situationsabhängig und bilden das Fundament für die Artefakte, die Sie erstellen. Zugleich können sie von einer KI repliziert und erlernt werden, um Ihren Workflow zu verbessern und Ihnen Zeit zurückzugeben, damit Sie sich stärker auf strategische Entscheidungen auf höherer Ebene konzentrieren können. Weniger Routineaufwand, mehr Produktivität.

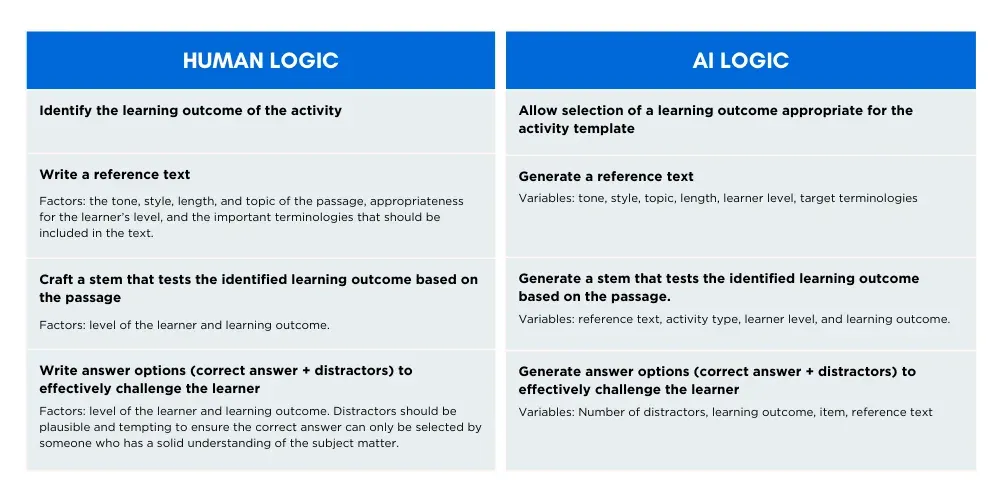

Das nachfolgende Diagramm zeigt einen möglichen Ansatz, um einige der strategischen Entscheidungen, die Instructional Designerinnen und Designer bei der Erstellung von Multiple-Choice-Fragen (MCQs) treffen, in ein Framework zu übersetzen, dem eine KI folgen kann. So lassen sich vergleichbare oder sogar bessere Ergebnisse in einem Bruchteil der Zeit erzielen.

Beim Erstellen von Multiple-Choice-Fragen (MCQs) berücksichtigen Instructional Designer eine Vielzahl von Faktoren, die die Qualität der Bewertung beeinflussen.

Mithilfe der Methodik von Docebo erfassen wir all diese Faktoren und verwenden sie als Eingabevariablen, um ein Ergebnis zu erzeugen, das all diese sonst menschlichen Entscheidungen widerspiegelt. Beachten Sie, dass die Abfolge der Entscheidungen auch mit der Reihenfolge im menschlichen Authoring-Prozess sowie den Abhängigkeiten jeder einzelnen Entscheidung übereinstimmt. Beispielsweise würden menschliche Autorinnen und Autoren bei einer Leseverständnisaufgabe zunächst einen Referenztext erstellen, danach den Fragetext (Stem) formulieren und schließlich die Antwortoptionen entwickeln. Genau diese Reihenfolge wird auch bei der Ausführung der Prompt-Ketten im Generierungsprozess beachtet.

Die heutige KI für das Lernen benötigt nach wie vor Anleitung durch den Menschen. Daher werden die effektivsten Lernprodukte Methodologien menschlicher Expertinnen und Experten (wie die oben dargestellte) zugrunde legen, damit sie ähnlich denken und Entscheidungen treffen können wie ein Instructional Designer.

Nächste Schritte

Jetzt, da Sie mehr über KI für das Lernen wissen, sind Sie bereit, mit Ihrer Suche zu beginnen. Bevor Sie jedoch starten, empfehlen wir, diese sechs Fragen zu beantworten, um Sie und Ihr Team bei der Evaluierung potenzieller Anbieter und beim Einkauf von KI-Lernprodukten zu leiten.

Sechs zentrale Fragen, die vor der Zusammenarbeit mit Anbietern beantwortet werden sollten

- Was ist der Auslöser für Ihre Kaufentscheidung?

Beruht der Erwerb dieses Produkts darauf, ein bestehendes Problem zu lösen, oder steht ein Restbudget zur Verfügung und die Demo wirkte einfach nur beeindruckend? - Wie wird sich das Produkt auf das Benutzererlebnis auswirken?

Baut dieses Produkt auf dem bestehenden Verhalten der Nutzer auf, oder erwartet es, dass sie neue Fähigkeiten erlernen? (Und welche Konsequenzen hat dies für Onboarding und Time-to-Value?) - Wer hat die Kontrolle über Daten und Prozesse?

Wer entscheidet, welche Daten für das KI-Modell relevant sind? Wo werden Ihre Daten gespeichert und verarbeitet? - Wie vermeiden Sie das Black-Box-Problem?

Können Sie die Entscheidungen des KI-Modells bei Bedarf einsehen, erklären oder überschreiben? - Steht das Lernen im Mittelpunkt des KI-Modells?

Wird die Erstellung von Lernmaterialien durch Mustererkennung gesteuert, oder sind pädagogisch effektive Strategien eingebaut, die die KI-Prozesse leiten? - Wie werden Sie dieses Produkt verwalten?

KI-Produkte hängen von der Qualität ihrer Eingaben ab. Wie stellen Sie sicher, dass die Inhalte, die die KI verarbeitet, echt, relevant und zuverlässig sind?

Über Docebo KI

Wir sind der Überzeugung, dass künstliche Intelligenz eine der mächtigsten Möglichkeiten für Innovationen im Bereich Lernen und Entwicklung bietet. Als führendes Unternehmen in diesem Bereich folgen wir keinen Trends – wir setzen sie. Die Lernplattform von Docebo wird durch künstliche Intelligenz unterstützt, wobei mehrere KI-Funktionen im gesamten System integriert sind, um die Art und Weise zu verbessern, wie Unternehmen ihre Lernprogramme bereitstellen, verwalten und skalieren.

Im Folgenden finden Sie einige Leitprinzipien, wie wir KI in unseren Produkten und Dienstleistungen betrachten und was Sie von Docebo AI erwarten können:

Pädagogik-orientierter Ansatz:

Im Bereich Lernen und Entwicklung reicht ein KI-Framework ohne pädagogische Grundlagen und bewährte Lehrmethoden nicht aus. Unser KI-Produktteam umfasst pädagogische Expertinnen und Experten, die einen pädagogik-orientierten Ansatz bei der Gestaltung unserer KI-Lösungen verfolgen, um die Lernergebnisse zu maximieren und gleichzeitig Halluzinationen und ungenaue Ergebnisse zu minimieren.

Kontinuierliche Bewertung:

Wir entwickeln einen Zyklus aus robustem, kontinuierlichem Lernen und Assessments, um unsere KI-Modelle zu informieren. Wenn KI-Modelle ausschließlich auf Mustererkennung und Replikation beruhen, sind die Ergebnisse für Lerninhalte nicht geeignet. Durch das Verständnis und die Nutzung der Lernleistung über integrierte Assessments wird der Lernfluss nie unterbrochen und eine umfassendere Perspektive gewährleistet. Docebo AI ist mit dem großen Ganzen verbunden und bietet die grundlegende Basis für hyper-personalisierte Lernprozesse.

Streben nach individualisiertem Lernen:

Hyperpersonalisierung und Lernen im Arbeitsfluss sind unvermeidliche Ergebnisse von KI im Lernbereich. Bei Docebo konzentrieren wir uns darauf, dies unseren Kundinnen und Kunden durch eine intelligente Umsetzung sicherer und effektiver KI bereitzustellen.

Inspektierbar, erklärbar, überschreibbar:

Eine effektive KI-Lösung für das Lernen entfernt niemals den Menschen aus dem Prozess oder dessen Ergebnissen. Bei Docebo stehen Inspektierbarkeit, Erklärbarkeit und Überschreibbarkeit im Mittelpunkt unserer Produkte und Dienstleistungen, sodass die Nutzerinnen und Nutzer die Kontrolle behalten und Vertrauen in ihre Arbeit haben.

Freiraum für das Wesentliche:

Docebos Ziel ist es, KI-Lösungen für das Lernen zu entwickeln, die einen Großteil der repetitiven und zeitaufwändigen Arbeit übernehmen, damit Lerndesigner sich auf das Wesentliche konzentrieren können – wie Dateninterpretation, Content Governance, strategische Entscheidungen und ganzheitliches Lern-Design.

Kontrolle behalten:

Organisationen sollten steuern können, wie KI innerhalb ihres Unternehmens eingesetzt wird. Die Lösungen von Docebo geben Unternehmen die Kontrolle über ihre eigenen Daten, sodass sie entscheiden können, wie (und ob) diese verwendet werden. Zudem bieten wir eine Datenanonymisierung in unserem eigenen Large Language Model (LLM), um Datenschutz und Kontrolle zu gewährleisten.

Mitwirkende

Michael Chong

Senior Data Scientist (Docebo)

Rebecca Chu

Machine Learning Analyst (Docebo)

Vince De Freitas

Product Marketing Manager, Content & AI (Docebo)

Maija Mickols

AI Product Manager (Docebo)

Giuseppe Tomasello

Vice President of AI (Docebo)

Renee Tremblay

Senior Content Marketing Manager, (Docebo)